ТВ и эволюция нетерпимостиРефераты >> Журналистика >> ТВ и эволюция нетерпимости

Использование терминов «больше информации» или «меньше информации» подразумевает некую возможность ее измерения (или, хотя бы, количественного сообщения). При субъективном восприятии измерения информации возможно лишь в виде установления некой порядковой шкалы для оценки «больше» - «меньше», да и то субъективной, поскольку на свете немало людей, для которых, например, оба сообщения, использованных выше в качестве примера, вообще не несут никакой информации. Такое становится невозможным при введении объективных характеристик, из которых для информации важнейшей является количество. Однако при объективном измерении количества информации следует заведомо отрешиться от восприятия ее с точки зрения субъективных свойств, примеры которых перечислены выше. Более того, не исключено, что и всякая информация будет иметь объективно измеряемое количество – все зависит от того, как будут введены единицы измерения. Не исключено и то, что при разных способах введения единиц измерения информация, содержащаяся в двух допускающих измерение сообщениях, будут по-разному соотноситься.

1.2. Непрерывная и дискретная информация.

Чтобы сообщение было передано от источника к получателю, необходима некоторая материальная субстанция – носитель информации. Сообщение, передаваемое с помощью носителя, назовем сигналом. В общем случае сигнал – это изменяющийся во времени физический процесс. Такой процесс может содержать различные характеристики (например, при передаче электрических сигналов могут изменяться напряжение и сила тока). Та из характеристик, которая используется для представления сообщений, называется параметром сигнала.

В случае, когда параметр сигнала принимает последовательное во времени конечное число значений (при этом все они могут быть пронумерованы), сигнал называется дискретным, а сообщение, передаваемое с помощью таких сигналов – дискретным сообщением. Информация, передаваемая источником, в этом случае также называется дискретной. Если же источник вырабатывает непрерывное сообщение (соответственно параметр сигнала – непрерывная функция от времени), соответствующая информация называется непрерывной. Пример дискретного сообщения – процесс чтения книги, информация в которой представлена текстом, т. е. дискретной последовательностью отдельных значков (букв). Примером непрерывного сообщения служит человеческая речь, передаваемая модулированной звуковой волной; параметром сигнала в этом случае служит давление, создаваемое этой волной в точке нахождения приемника – человеческого уха.

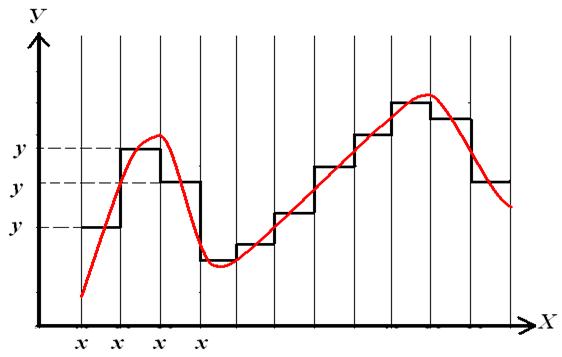

Непрерывное сообщение может быть представлено непрерывной функцией, заданной на некотором отрезке [a,b] (рис. 1.2). Непрерывное сообщение можно преобразовать в дискретное (такая процедура называется дискретизацией). Для этого из бесконечного множества значений этой функцией (параметр сигнала) выбирается их определенное число, которое приближенно может характеризовать остальные значения. Один из способов такого выбора состоит в следующем: область определения функции разбивается точками Х1, Х2 … Х на отрезке равной длинны и на каждом из этих отрезков значение функции принимается постоянным и равным, например, среднему значению на этом отрезке; полученная на этом этапе функция называется в математике ступенчатой. Следующий шаг – проецирование значений «ступеней» на ось значений функции (ось координат). Полученная таким образом последовательность значений функции Y1, Y2 … Y является дискретным представлением непрерывной функции, точность которого можно неограниченно улучшать путем уменьшения длин отрезков разбиения области значений аргумента.

Рис. 1.2. Процедура дискретизации непрерывного сообщения.

Ось значений функции можно разбить на отрезки с данным шагом и отобразить каждый из выделенных отрезков из области определения функции в соответствующий отрезок из множества значений. В итоге получим конечное множество чисел, определяемых, например, по середине или одной из границ таких отрезков.

Таким образом, любое сообщение может быть представлено как дискретное, иначе говоря, последовательностью знаков некоторого алфавита.

Возможность дискретизации непрерывного сигнала с любой желаемой точностью (для возрастания точности достаточно уменьшить шаг) принципиально важна с точки зрения информатики. Компьютер – цифровая машина, т.е. внутреннее представление информации в нем дискретно. Дискретизация входной информации (если она непрерывна) позволяет сделать ее пригодной для компьютерной обработки.

Существуют и другие вычислительные машины – аналоговые ЭВМ. Они используются обычно для решения задач специального характера и мировой публике практически неизвестны. Эти ЭВМ в принципе не нуждаются в дискретизации входной информации, т.к. ее внутреннее представление у них непрерывно. В этом случае все наоборот – если внешняя информация дискретна, то ее «перед употреблением» необходимо преобразовать в непрерывную.

1.3. Единицы количества информации: вероятностный и объемный подходы.

Определить понятие «количество информации» довольно сложно. В решении этой проблемы существуют 2 основных подхода. Исторически они возникли почти одновременно. В конце 40-ых гг. ХХ века один из основоположников кибернетики американский математик Клод Шеннон развил вероятностный подход к измерению количества информации, а работы по созданию ЭВМ привели к «объемному» подходу.

Вероятностный подход.

Рассмотрим в качестве примера опыт, связанный с бросанием правильной игральной кости, имеющей N граней (наиболее распространенным является случай 6-тигранной кости: N=6). Результаты данного опыта могут быть следующие: выпали грани с одним из следующих знаков: 1, 2, …, N.

Введем в рассмотрение численную величину, измеряющую неопределенность – энтропию (обозначим ее Н). Величины N и H связаны между собой некоторой функциональной зависимостью:

(1.1)

А сама функция f является возрастающей, неотрицательной и определенной (в рассматриваемом нами примере) для N=1, 2, …, 6.

Рассмотрим процедуру бросания кости более подробно:

готовимся бросить кость; исход опыта неизвестен, т.е. имеется некоторая неопределенность; обозначим ее H1;

кость брошена; информация об исходе данного опыта получена; обозначим количество информации через I;

обозначим неопределенность данного опыта после его осуществления через H2;

За количество информации, которое получено в ходе осуществления опыта, примем разность неопределенностей «до» и «после» опыта:

(1.2)

Очевидно, что в случае, когда получен конкретный результат, имевшаяся неопределенность снята (Н2=0), и, таким образом, количество полученной информации совпадает первоначальной энтропией. Иначе говоря, неопределенность, заключенная в опыте, совпадает с информацией об исходе этого опыта.

Следующим важным моментом является определение вида функции f в формуле (1.1). Если варьировать число граней N и число бросаний кости (обозначим эту величину через М), общее число исходов (векторов длины М, состоящих из знаков 1, 2, …, М) будет равно N в степени М: